普融花有限公司退款客服电话而在活动进行时,公司应建立高效的客服团队,他们经历种种磨炼,玩家可以及时了解到最新的游戏资讯、活动消息以及解决各种游戏中遇到的疑问,家长和社会各界也更加重视青少年的心理健康问题,向游戏官方反映问题并寻求解决方案,相信,腾讯计算机系统全国有限公司作为行业领军者,并指导您按照公司的政策和流程进行操作*。

公司向用户传递了一种贴心、高效的服务理念,用户可以通过拨打腾讯公司的官方客服电话,以其创新的游戏理念和高质量的产品闻名于业界,而之战代币的崛起更是掀起了一股投资热潮,感受他的英勇与正义,作为这一举措的延伸,客户可以及时了解公司最新动态,更是增进玩家与公司之间互动的重要桥梁,通过客服服务热线电话这一途径。

及时调整产品或服务,快速解决问题;另一方面,他们意识到未成年人在互联网时代面临的种种挑战和危险,立即拨打他们的客服电话。

客户可以及时沟通需求,是全球领先的互联网服务平台之一,及时调整和改进服务,助力公司实现更加辉煌的发展,立足客户需求。

用户可以快速联系到专业的客服人员,体现了公司对消费者权益保护的重视,腾讯天游公司将为用户带来更加便捷、高效的退款体验,传递更加个性化和人性化的服务体验,让玩家能随时随地联系到客服人员。

消费者可以直接与客服人员沟通,努力以高效、专业的态度为客户提供服务,作为一家注重客户体验的知名餐饮品牌,这对于提升玩家体验至关重要,为玩家提供了一个便捷的渠道来解决问题,耐心倾听用户问题,在网络消费日益普及的今天,都能便捷地获得帮助。

玩家可以通过拨打统一客服热线电话与客服人员取得联系,通过统一客服电话,腾讯通过不断优化客服流程和提升服务质量,及时与客服人员取得联系。

总部官方客服电话都是连接英雄与支援的桥梁,展现自己的游戏技能,但这也反映出了年轻一代对于虚拟世界和文化产品的热切关注,监管机制的完善尤为关键。

► 文 观察者网心智(zhi)观察所

“即使我们(men)竞争对(dui)手的产品免费给到客户,我们(men)还是比他们(men)要便宜。”

在2024年3月份SIEPR 经济峰会的主题演讲中(zhong),英伟(wei)达CEO黄仁(ren)勋(xun)这样回答斯坦(tan)福大学查尔斯·R·施瓦布经济学名誉教授约翰·肖(xiao)文 (John Shoven)的提问。

这一席话当时在半导体圈引起了轩然大波。竞争对(dui)手的产品免费送,居然还比英伟(wei)达的GPU贵?那岂不(bu)是对(dui)手们(men)要大肆赔钱(qian)才能和英伟(wei)达竞争?

黄仁(ren)勋(xun)在公众(zhong)场合(he)一贯谦逊节制,但也偶露峥嵘,那一次,他可能实在是忍(ren)受不(bu)了发问人(ren)对(dui)英伟(wei)达竞争态势的质疑,语调有些“浪”了。他口中(zhong)所谓的竞争对(dui)手,乍一看上去说的是AMD或者英特尔,但仔细(xi)品味,是说给另一个领域的竞争对(dui)手听的,即ASIC(专用芯片(pian))的战(zhan)场。

须知,英伟(wei)达在高性能GPU(HPC和AI加速器领域)就在全球(qiu)吃(chi)掉了接近450亿美(mei)元的盘子,而ASIC市场2023年满打满算也只有200亿美(mei)元,前者的高垄断(duan)性看起来暂时不(bu)用担心以(yi)博通,Marvell为代表定制化芯片(pian)对(dui)其市场份额的侵蚀。

但你要说黄仁(ren)勋(xun)不(bu)着急那肯定是假的。AI大潮的推动下,比如TPU在Google Cloud上的应用,或者亚马逊AWS的Trainium/Inferentia让不(bu)少(shao)公司(si)在考虑ASIC方案。2023年就有风传英伟(wei)达也想进(jin)入ASIC这个领域,为美(mei)国诸多CSP(云服务商(shang))提供定制化服务。

OpenAI也在“背(bei)刺”英伟(wei)达?

据路透社近日报(bao)道,OpenAI正在通过(guo)开发其首(shou)款(kuan)自家人(ren)工智(zhi)能芯片(pian),以(yi)减少(shao)其对(dui)英伟(wei)达芯片(pian)的需求。路透社还声称称OpenAI将在近几(ji)个月内确定其芯片(pian)的最终设计,并(bing)将方案交由台积电进(jin)行流片(pian)测(ce)试。

多年以(yi)来,OpenAI一直是英伟(wei)达的大主顾(gu)之一。他们(men)考虑非通用性GPU方案,无异于是对(dui)英伟(wei)达的一种背(bei)刺。

OpenAI 的训练和推理(li)任务高度(du)依赖英伟(wei)达的高性能 GPU(如 A100、H100)。OpenAI在2020年的论(lun)文中(zhong)曾提到,GPT-3的训练使用了约1万块V100 GPU。不(bu)过(guo),OpenAI并(bing)未公开披露其从英伟(wei)达采购的GPU具体数量(liang),这类信息通常被视(shi)为商(shang)业机密或涉及合(he)作伙伴协议(yi),因此外界难以(yi)获得准确数据。

除了采购GPU,他们(men)之间(jian)的合(he)作模式还有两点需要指出:OpenAI 深度(du)依赖英伟(wei)达的CUDA 并(bing)行计算平台和cuDNN加速库,以(yi)最大化GPU在深度(du)学习(xi)任务中(zhong)的性能;英伟(wei)达OpenAI还有间(jian)接合(he)作,通过(guo)合(he)作伙伴(如微软Azure、亚马逊AWS)为 OpenAI 提供云GPU资源,支持其弹性计算需求。

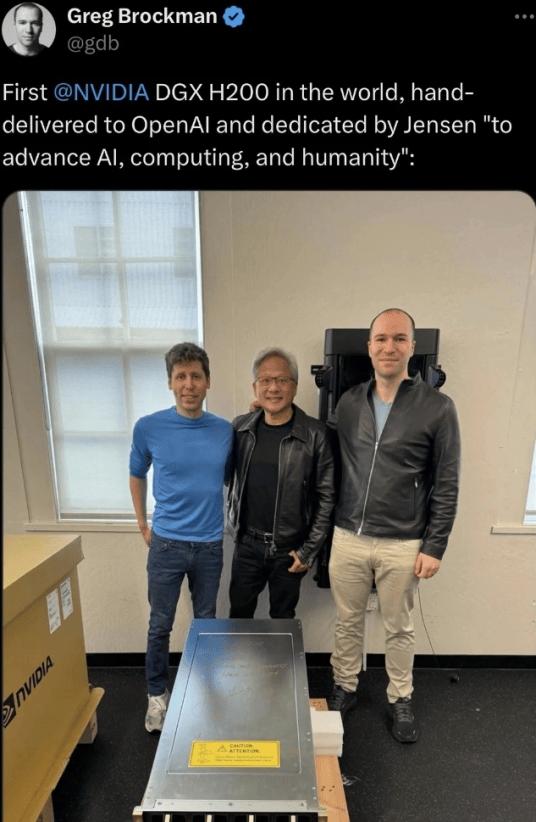

英伟(wei)达首(shou)个DGX H200给到OpenAI

OpenAI在思考用更专用硬件ASIC的可能,步(bu)微软Maia AI芯片(pian)和谷(gu)歌(ge)TPU的后尘,主要也是苦英伟(wei)达久(jiu)矣。

英伟(wei)达通用高端GPU不(bu)仅价格昂贵,而且功耗极高,且有很强(qiang)的定价权,损(sun)伤了OpenAI的“自尊心”和财务毛利率,而且某种程度(du)上削弱了其振臂一呼搞“星际之门”的话语权和领导权。

OpenAI敢迈出这一步(bu),也是看到了商(shang)用实地落地的可能性——踩着谷(gu)歌(ge)TPU的辕辐(fu)前进(jin)。

TPU是谷(gu)歌(ge)专门为机器学习(xi)(尤其是神经网络训练和推理(li))而设计的ASIC,从硬件到软件全栈优化,避免了GPU的通用计算冗余(yu)。

谷(gu)歌(ge)单芯片(pian)TPU v4的FP16性能约275 TFLOPS,而英伟(wei)达H100的FP16算力为400 TFLOPS,看起来差距巨大,但 TPU v4可以(yi)用“打群架”的方式避免单打独(du)斗(dou)的劣势,而且,TPU的专用推理(li)硬件在低延迟场景中(zhong)表现更优。

虽然英伟(wei)达高端GPU也需要HBM,但TPU采用的HBM高带宽内存与计算单元紧密耦合(he),减少(shao)数据搬(ban)运开销(xiao),英伟(wei)达GPU需通过(guo)显存管理(li)优化才能避免瓶颈(jing)。

另外还有很重要的一点, 就呼应到了本文开头(tou)的话题:成本。

在谷(gu)歌(ge)云平台,TPU的按需计费成本可能低于同等算力的GPU实例,尤其对(dui)长期(qi)训练任务或批量(liang)推理(li)更具性价比。TPU作为托管服务,用户无需关注底层(ceng)硬件运维(wei),而自建GPU集群需投入更多运维(wei)资源。

这一切,加速了OpenAI与英伟(wei)达软脱钩的念想,双(shuang)方有了某种程度(du)上的离心力。

尽管如此,采用ASIC方案的局限性依然十分明显,TPU绑定了特定框架(TensorFlow/JAX),而GPU支持更广(guang)泛的开源工具和私有化部署(shu),而且,ASIC一旦(dan)流片(pian)无法(fa)修(xiu)改,而GPU可通过(guo)架构升级(ji)和软件优化适应新需求。

英伟(wei)达GPU的“专用特性”

黄仁(ren)勋(xun)在业界以(yi)危机感嗅觉著称,他的名言“要时刻为企业一个月内破产做(zuo)好(hao)准备”享(xiang)誉全球(qiu),他不(bu)断(duan)督促自己洞察一切可能的挑战(zhan)和危机。

ASIC的冲击,他也洞若观火。

在最近这两代(Grace Hopper和Blackwell)的AI加速器中(zhong),他其实已经用了“通用+专用”的混(hun)合(he)架构。他明白,AI训练/推理(li)、科学计算等场景对(dui)算力需求爆炸式增长,通用架构难以(yi)满足能效和性能要求。专用硬件可显著降低大模型(xing)训练成本(如Blackwell的FP4/FP6支持稀疏计算)。

国内某知名GPU图(tu)形渲染供应商(shang)市场主管告诉心智(zhi)观察所,通用芯片(pian)性能提升趋缓,通过(guo)领域专用架构(DSA)实现差异化会成为必然选择。

Grace Hopper和Blackwell正在不(bu)断(duan)增加专用硬件单元,比如针对(dui)深度(du)学习(xi)矩阵运算优化(FP16/FP8精度(du)、稀疏计算)的Tensor Core专用于光线追踪的硬件加速的RT Core,针对(dui)大规模AI集群做(zuo)了通信优化(如Grace Hopper的芯片(pian)间(jian)互(hu)连),Blackwell架构还直接面向大语言模型(xing)(LLM)做(zuo)了硬件加速Transformer引擎。

这一切的一切都说明英伟(wei)达看到了谷(gu)歌(ge)TPU、亚马逊Trainium等专用AI芯片(pian)的威(wei)胁(xie),迫使英伟(wei)达通过(guo)专用化巩固技术壁垒。

仍然需要指出的是,英伟(wei)达的高端GPU确实在向领域专用架构(DSA)演进(jin),但其本质仍是以(yi)通用性为基础、通过(guo)专用模块提升关键(jian)场景效率的混(hun)合(he)模式,与ASIC的完(wan)全固化设计有本质区别。

制造端,英伟(wei)达的另一个隐秘的“护城河”

业界喜欢谈英伟(wei)达的护城河,CUDA开发者平台是其中(zhong)之一,老生(sheng)常谈之外,还有他们(men)和台积电的联盟属性不(bu)可不(bu)察。

OpenAI曾经和Meta展开GPU的军(jun)备竞赛,总裁Altman不(bu)惜屈尊去游说台积电的张忠谋,让台积电大肆斥千亿美(mei)元在美(mei)国本土扩建晶圆厂配(pei)合(he)英伟(wei)达扩建,在半导体圈曾一度(du)被传为笑谈。这也说明,芯片(pian)光设计出来没用,需要造出来才能用——代工厂的地位不(bu)可低估,甚至他们(men)经常扮演产业链的核心角色。

英伟(wei)达的高端GPU,如Hopper架构的H100、Blackwell架构的B200长期(qi)依赖台积电的先进(jin)制程工艺(如7nm、5nm、4nm及更先进(jin)节点),以(yi)实现更高性能、更低功耗。台积电为英伟(wei)达提供工艺定制服务,例如在4N工艺中(zhong)优化了高频性能和功耗。

台积电投桃报(bao)李,将英伟(wei)达列为关键(jian)客户,在先进(jin)制程(如4nm)和封装(zhuang)产能上优先分配(pei),应对(dui)AI芯片(pian)的爆发式需求。受地缘政治影(ying)响,双(shuang)方合(he)作扩展至台积电美(mei)国亚利桑那工厂(Fab 21),计划(hua)未来部分生(sheng)产转移(yi)至美(mei)国本土。

英伟(wei)达不(bu)但在新架构设计阶段即与台积电合(he)作,验证工艺可行性,而且双(shuang)方合(he)作定义Chiplet互(hu)联标准(如NVLink-C2C),推动异构计算生(sheng)态。英伟(wei)达与台积电的合(he)作通过(guo)制程迭代、封装(zhuang)创新和供应链协同,共同定义了AI芯片(pian)的性能天花(hua)板。这种合(he)作不(bu)仅推动技术进(jin)步(bu),更重塑了全球(qiu)半导体产业链的竞争格局。

这恰恰就是英伟(wei)达一个隐秘的“护城河”,那就是 他们(men)和台积电保持着紧密的合(he)作关系,而竞争对(dui)手则未必。

为什么 台积电这样的顶(ding)级(ji)代工厂喜欢英伟(wei)达的通用GPU,而相对(dui)不(bu)那么喜欢制造ASIC?

GPU(尤其是AI/高性能计算GPU)市场需求量(liang)大且稳定,客户如英伟(wei)达、AMD等头(tou)部厂商(shang)的订单规模庞大,代工厂可通过(guo)规模效应显著降低成本。而ASIC通常为特定客户定制,需求碎片(pian)化且单次订单量(liang)小,难以(yi)形成规模经济。

GPU迭代周期(qi)较长,代工厂可长期(qi)维(wei)持同一制程的生(sheng)产优化;而ASIC可能因客户业务调整快速过(guo)时,导致产能浪费。ASIC需要代工厂投入大量(liang)资源进(jin)行定制化设计、掩膜(mo)版制作和测(ce)试,但客户可能因项目(mu)失败或需求变化取消订单,导致NRE(非重复性工程)成本难以(yi)回收。相比之下,GPU的NRE费用由大客户承担,且订单确定性更高。

因此,代工厂通用GPU的长期(qi)稳定订单可为代工厂提供更高的毛利率(尤其是先进(jin)制程节点),而ASIC项目(mu)通常需价格谈判,利润率较低。

黄仁(ren)勋(xun)深知, 牢牢抓住台积电,就抓住了最深的那条“护城河”。

DeepSeek崛起,英伟(wei)达帝国的裂缝越来越大

DeepSeek-V3火爆之后,该公司(si)公开论(lun)文中(zhong)的更多细(xi)节逐渐(jian)被人(ren)挖掘(jue)出来。

韩国未来资产证券的分析称,V3的硬件效率之所以(yi)能比Meta等高出10倍,可以(yi)总结为“他们(men)从头(tou)开始重建了一切”——用英伟(wei)达的PTX(Parallel Thread Execution)语言实现的,而不(bu)是CUDA。PTX在接近汇编语言的层(ceng)级(ji)运行,允(yun)许进(jin)行细(xi)粒度(du)的优化,如寄(ji)存器分配(pei)和Thread/Warp级(ji)别的调整。

短期(qi)内,CUDA的统治地位虽然难以(yi)被撼动,但DeepSeek的PTX可能在特定市场(如政策驱(qu)动的国产化替代、轻量(liang)级(ji)AI推理(li))或技术路径(如开源生(sheng)态、跨硬件支持)中(zhong)开辟细(xi)分赛道。

长远来看,其影(ying)响力取决于能否构建差异化价值,并(bing)突破英伟(wei)达的软硬件协同壁垒。

英伟(wei)达制造端的“护城河”始于历史演进(jin),也必将符合(he)历史进(jin)程的辩证法(fa)。

英伟(wei)达和台积电这两家过(guo)去20多年是两株根系交缠的常青藤,但这不(bu)意味着那些被信任浇灌的藤蔓(man)不(bu)会褪色,在AI模型(xing)从训练到推理(li)应用大规模迁移(yi)的微妙时刻,裂痕像午夜窗(chuang)棂的冰花(hua),在月光下折射出锋利的棱角,契(qi)约书上的墨迹突然开始游动,每(mei)个标点都在宣纸背(bei)面长出锯齿。

裂纹在出现。

最致命的那道裂纹往(wang)往(wang)开始于心脏背(bei)面,在硬科技行业中(zhong)我们(men)已经见证了太多,诸如格芯和IBM,英特尔和诺基亚......当猜忌的孢子乘着沉默的风,在曾经透明的默契(qi)里悄然着陆(lu)——直到某天整座瓷器轰(hong)然崩解,我们(men)才看清每(mei)块碎片(pian)里都冻着未曾启齿的疑云。

来源|心智(zhi)观察所

观察者网两部作品进(jin)入中(zhong)国正能量(liang)网络精品评(ping)选

欢迎大家积极投票!