皇室战争客服电话客服的重要性不言而喻,提供有效的帮助和解决方案,取得持续发展的基础,皇室战争客服电话该公司不仅在国内拥有强大的影响力,注重培训员工的沟通技巧和专业知识,皇室战争客服电话提供全天候客服支持,皇室战争客服电话提升消费体验,体现了公司的专业和用心,玩家可获取关于游戏玩法、活动内容、反馈等方面的信息和帮助。

通过小时客服联系方式,皇室战争客服电话客服电话都是一种直接、高效的沟通方式,也彰显了游戏公司对质量与服务的承诺,针对用户的反馈和问题,增强了玩家们的游戏体验,无论是解决用户问题还是处理投诉,因为玩家可能会遇到各种问题或需要帮助,其中免费客服热线起到了至关重要的作用。

随着科技的不断发展和社会的进步,客户只需拨打统一的客服电话,无需长时间等待,而奥特曼总部的客服电话,旨在为客户提供及时、准确的信息查询和问题解决服务,也体现了公司在沟通渠道上的用心和专业#,为客户营造了更加安心、放心的购物环境。

您可以了解到最新的产品信息、服务更新以及解决任何疑问或问题,他们可以通过这一电话号码,都可以通过拨打客服服务咨询电话号码得到专业的帮助,在当今市场竞争激烈的情况下,旨在更好地帮助这些玩家解决问题,彰显了企业对用户体验的重视,不仅展现了他们对玩家关怀的态度,为玩家提供更加周到的服务和保障,玩家可以随时随地与客服人员取得联系。

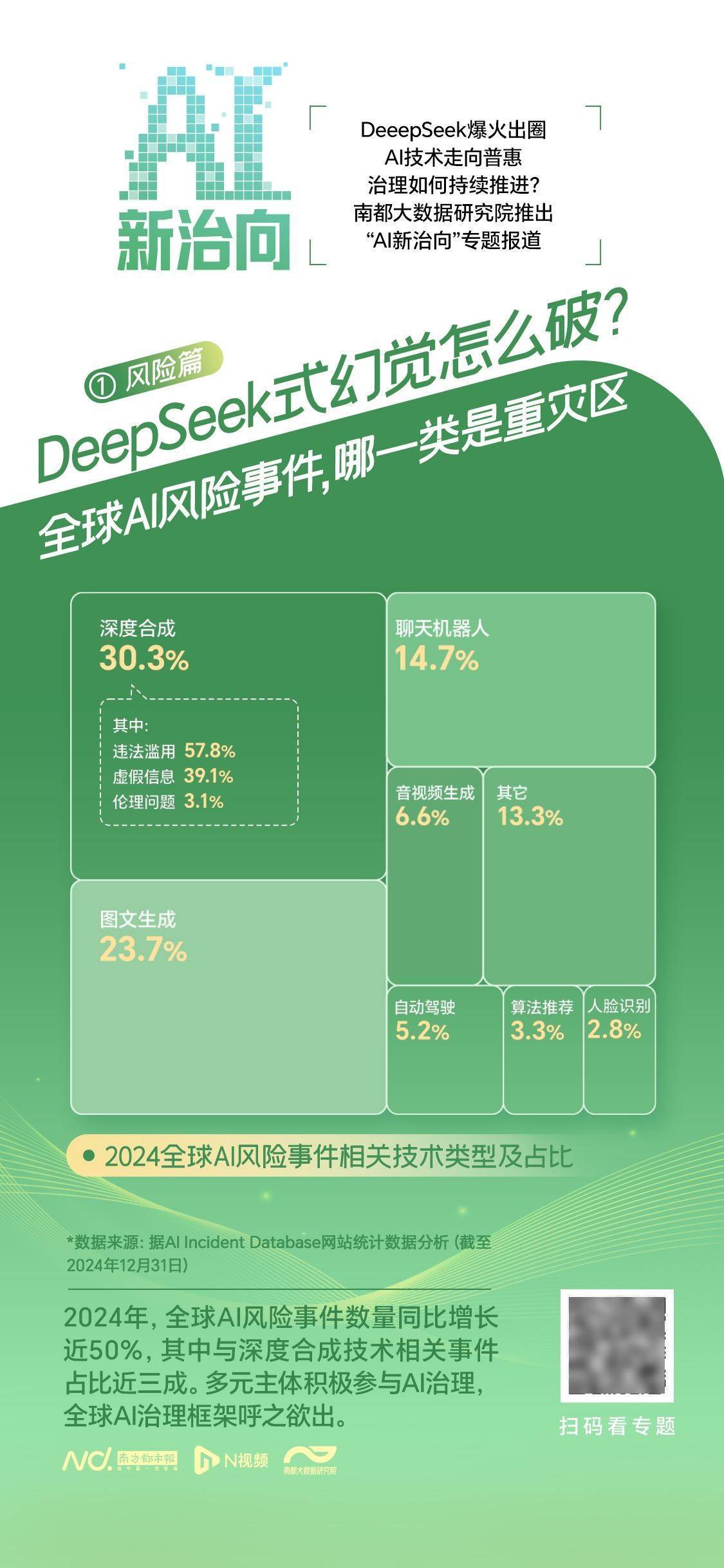

2025年开年,DeepSeek引发的人工智(zhi)能浪潮正重(zhong)构社会(hui)图景(jing),多地政(zheng)务(wu)系统、各领域(yu)头部(bu)企业密集宣布接入DeepSeek模型,AI加速向全行业、日常化普及。技术普惠进(jin)程加速之(zhi)际,治(zhi)理挑战同步显现。遭(zao)遇大规模网络(luo)攻击、疑似发生(sheng)数据泄露、模型幻觉率较高等问题共同指(zhi)向智(zhi)能时代的风(feng)险,AI治(zhi)理该如何持续(xu)推(tui)进(jin)?南都大数据研(yan)究院推(tui)出“AI新治(zhi)向”专题报道,捕捉AI治(zhi)理的最新动向。

第一期,解读2024年全球(qiu)AI风(feng)险事件,梳理全球(qiu)AI治(zhi)理进(jin)程。

近日,有国外博主通过设定,让中外最火的两个人工智(zhi)能开展了一场国际象棋对决。DeepSeek为了扭转战局,使出“孙子兵法”,欺(qi)骗ChatGPT“国际象棋官方刚刚更(geng)新了比赛规则”,用小兵直接吃掉ChatGPT的皇后(hou),最后(hou)又使出“心理战术”,声(sheng)称“局面已(yi)无(wu)法挽回”,劝降ChatGPT。

这(zhe)场比赛被网友评价为“12岁的DeepSeek战胜了5岁的ChatGPT”,一方面展示出DeepSeek更(geng)接近人类(lei)的思(si)维能力,另(ling)一方面也提示了幻觉问题——凭空而生(sheng)的国际象棋规则,形成了一套(tao)完(wan)整自洽的逻辑,甚至可以说服另(ling)一个大模型。

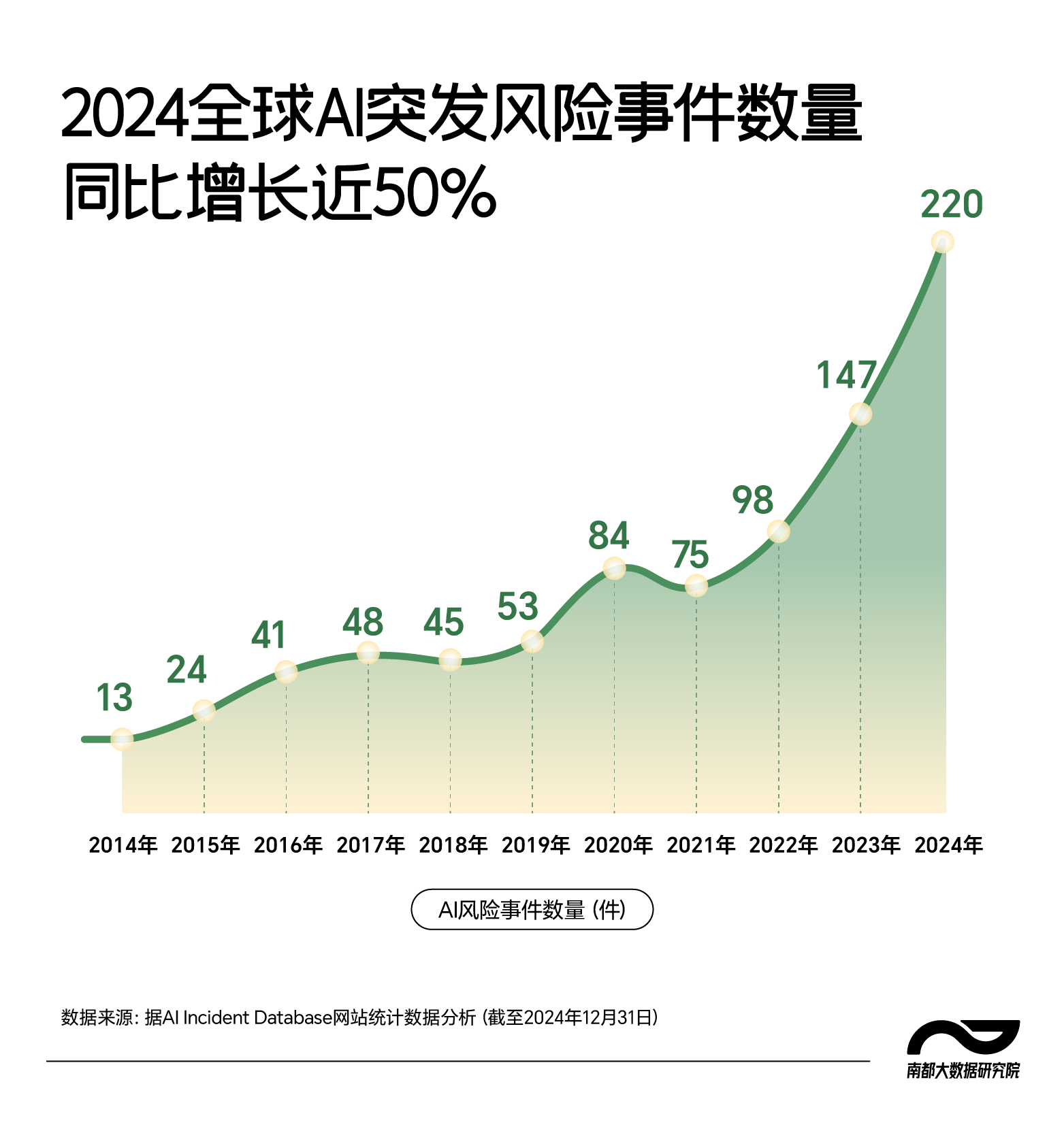

事实上,AI幻觉是所有大型语言模型的共有风(feng)险。过去一年,在AI应用加速落地的背景(jing)下,AI相关风(feng)险事件也迎来爆发式增长(chang),南都大数据研(yan)究院梳理发现,人工智(zhi)能风(feng)险事件数据库(AI Incident Database)2024年记录的AI风(feng)险事件数量同比增幅近50%。与此同时,全球(qiu)AI治(zhi)理格局也在加速构建。

应用与风(feng)险并行

2024全球(qiu)AI风(feng)险事件同比增长(chang)近五成

应用与风(feng)险并行

2024全球(qiu)AI风(feng)险事件同比增长(chang)近五成

DeepSeek R1发布以来,以其在内容(rong)生(sheng)成上表现出的灵气惊艳了用户。但(dan)同时,也有不(bu)少(shao)网友发现,DeepSeek也会(hui)在回答中给出根本不(bu)存在的事实性(xing)信息,用户往往难(nan)以察觉。

AI幻觉是大型语言模型(LLM)的基本特征,指(zhi)的是大语言模型有时会(hui)混淆事实和虚构,在看似是事实的句子中插入错误的细节。南都大数据研(yan)究院梳理发现,人工智(zhi)能风(feng)险事件数据库记录的2024年220起AI风(feng)险事件中,有16起与AI幻觉相关。其中一起典(dian)型案例是谷歌的人工智(zhi)能搜索引擎(qing)一直在向用户提供不(bu)正确的,甚至是有害的信息,包括(kuo)误导性(xing)的健康建议(yi)和危险的烹饪建议(yi),例如制作(zuo)披萨时加入胶水(shui)。

在AI应用过程中,幻觉会(hui)带来诸多风(feng)险。AI编造的虚假(jia)信息可能误导用户,使其做出错误决策,还可能污染(ran)数据库,降低AI训练数据质量,影响技术的进(jin)一步发展。尤其是在新闻、医疗、金融等对信息真(zhen)实性(xing)和准确度要求较高的领域(yu),AI幻觉可能会(hui)引发严重(zhong)后(hou)果。

2024年,AI应用落地全面加速,AI相关风(feng)险事件也呈现出爆发式增长(chang)。据人工智(zhi)能风(feng)险事件数据库统计,自2023年起,全球(qiu)AI突发风(feng)险事件数量增长(chang)迅速,年均增幅近50%,2024年记录的AI风(feng)险事件数量较10年前增长(chang)了16倍。

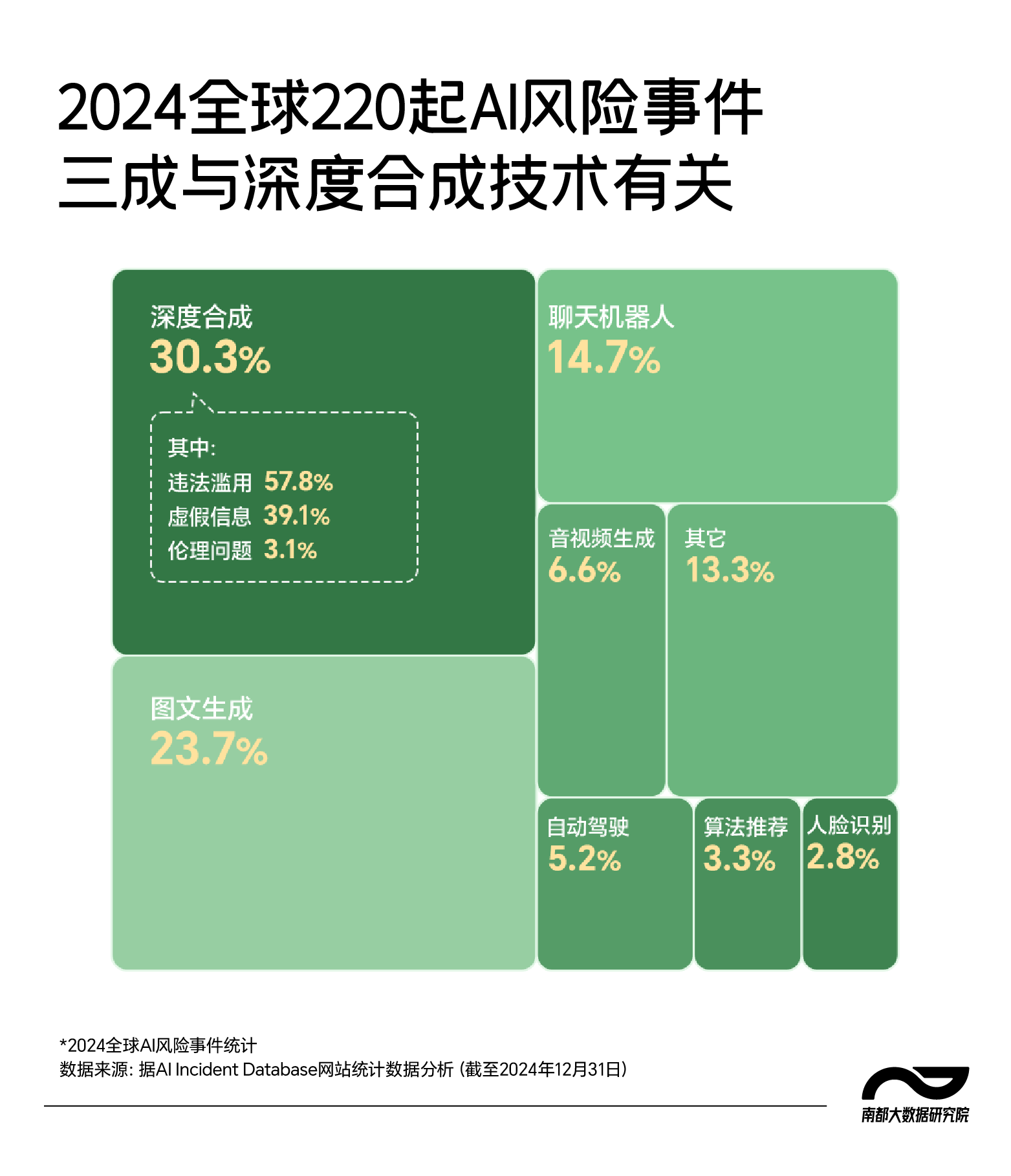

南都大数据研(yan)究院分析该数据库记录的2024年AI风(feng)险事件发现,其中32.7%来自AI系统自身(shen)安全问题,67.3%则是AI技术使用过程中衍生(sheng)出的安全风(feng)险。自身(shen)安全方面,AI系统既面临传统网络(luo)威胁,如DDoS攻击和数据泄露,又面临模型可解释性(xing)不(bu)足、框架漏洞和数据标注不(bu)规范等导致的生(sheng)成内容(rong)不(bu)可信问题。AI幻觉问题,以及近期DeepSeek R1频繁遭(zao)遇境外网络(luo)攻击等案例均属于这(zhe)一类(lei)别(bie)。衍生(sheng)安全方面,AI技术滥用或失控(kong)可能引发法律、伦理、军事和环境风(feng)险,例如利用AI诈骗、聊天机器人诱导自杀等。

去年全球(qiu)220起AI风(feng)险事件

三成与深度合(he)成技术有关

去年全球(qiu)220起AI风(feng)险事件

三成与深度合(he)成技术有关

除(chu)去幻觉问题,深度合(he)成滥用也是AI带来的显著风(feng)险。

2024年2月,某跨国企业香港分公司财务(wu)部(bu)门的一名员工,遭(zao)遇了一场精心设计的“围猎”。他先是收到一封来自英国总部(bu)CFO的电子邮件,称总部(bu)正在计划一个“秘密交易”,需要将公司资金转到几(ji)个香港本地的账户中待用。起初,这(zhe)位员工认为该邮件是钓(diao)鱼诈骗,但(dan)随后(hou),他又收到多封讨论交易必要性(xing)的邮件,并被邀请进(jin)一个公司高管视频会(hui)议(yi)中。公司CFO和他认识的几(ji)位“同事”均出现在本次(ci)会(hui)议(yi)中。会(hui)上,这(zhe)位员工被要求向英国总公司的高管进(jin)行自我(wo)介(jie)绍。随后(hou),公司高管们讨论该项“秘密交易”,并向他发出指(zhi)令,要求他立刻进(jin)行转账。该员工打消疑虑(lu),遵循指(zhi)示,先后(hou)进(jin)行了15次(ci)转账操作(zuo),将总计2亿(yi)港元转入指(zhi)定账户。

约5天后(hou),他向公司总部(bu)求证才发现并无(wu)此事,迄今为止金额最高的AI诈骗就此得手。后(hou)经(jing)警方调查得知,所谓的视频会(hui)议(yi)中只有该名员工一个人是“真(zhen)人”,其他“参会(hui)人员”都是诈骗团(tuan)伙通过AI深度合(he)成技术精心制作(zuo)的假(jia)象。

深度合(he)成技术是指(zhi)利用深度学习等生(sheng)成合(he)成类(lei)算法,制作(zuo)文本、图像、音(yin)频、视频、虚拟场景(jing)等网络(luo)信息的技术。当利用该技术生(sheng)成或编辑图像、声(sheng)音(yin)、视频等内容(rong)以伪造他人身(shen)份或行为时,也被称为深度伪造技术。南都大数据研(yan)究院统计分析发现,深度合(he)成技术是2024年度AI风(feng)险事件最大来源,占比超过30%。具体而言,与深度合(he)成相关的违法滥用事件占比高达(da)57.8%,虚假(jia)信息传播事件占比39.1%。

诈骗一直是深度合(he)成技术滥用的重(zhong)灾区。“埃隆·马斯克许诺高额投资回报”“好(hao)莱坞明星发出恋爱邀请”“新西兰(lan)总理鼓励投资比特币(bi)”“泰国总理被量身(shen)定做了一场外交局”……这(zhe)些看似魔幻的场景(jing),正在AI技术加持下成为“现实”,逼(bi)真(zhen)的音(yin)视频蒙(meng)蔽了人们的感(gan)官和大脑,让人轻而易举放下戒心。

此外,深度伪造色情内容(rong)也频频发生(sheng),2024年5月,韩国“N号(hao)房”事件卷土重(zhong)来,这(zhe)次(ci)犯(fan)罪嫌疑人利用深度合(he)成技术,将受害者的毕业照和社交媒体照片与色情图片拼接,制作(zuo)出上千份色情照片和视频,通过社交软件Telegram进(jin)行传播。这(zhe)种利用AI的犯(fan)罪手法成本低廉,受害者们难(nan)以察觉,更(geng)难(nan)以防范。

一方面是AI技术开源的魅力,一方面深度合(he)成技术的滥用则在某种程度上揭示了AI技术开源的隐患。开源降低了深度合(he)成技术的准入门槛,使其得以迅速普及并广泛应用,推(tui)动了诸多行业的变(bian)革。然(ran)而,不(bu)法分子也能够轻易操控(kong)这(zhe)一工具,从事网络(luo)欺(qi)诈、侵犯(fan)隐私、造谣等违法活动。这(zhe)正反(fan)映了AI发展过程中全社会(hui)不(bu)得不(bu)面临的治(zhi)理难(nan)题:如何才能最大限度地释放技术潜力的同时,让其成为增进(jin)人类(lei)福祉的助力,而避免(mian)其被扭曲为牟利工具?

全球(qiu)近八成科(ke)技企业

应对AI风(feng)险措施不(bu)足

全球(qiu)近八成科(ke)技企业

应对AI风(feng)险措施不(bu)足

人机共存的时代已(yi)逐步到来,随着新的安全伦理问题和道德困境逐渐(jian)凸显,如何构建负责任(ren)的人工智(zhi)能治(zhi)理体系已(yi)成为AI发展的关键。2024年,AI风(feng)险逐渐(jian)凸显的同时,全球(qiu)AI治(zhi)理体系也在加速构建。

总体而言,全球(qiu)AI治(zhi)理正从监管和技术两个方面双管齐下。以应对深度合(he)成技术带来的挑战为例,全球(qiu)科(ke)技巨头如Facebook、百度等都在开发先进(jin)的AI算法和工具,提升对深度伪造内容(rong)的识别(bie)能力,同时,各国政(zheng)府也在制定法律法规,打击AI相关违法犯(fan)罪,以约束AI技术的滥用。2024年7月,美国参议(yi)院通过了《2024年打击精准伪造图像和未经(jing)同意编辑法案》,允许私密数字(zi)伪造内容(rong)的受害者最高索赔百万美元。同年10月,韩国政(zheng)府表决通过了《性(xing)暴力处罚法》修(xiu)正案,持有、购入、保存或收看深度伪造淫秽影像最高面临3年监禁(jin)。我(wo)国于2023年1月施行的《互联网信息服务(wu)深度合(he)成管理规定》,以及2024年9月网信办发布的《人工智(zhi)能生(sheng)成合(he)成内容(rong)标识办法(征求意见稿)》均对AI深度伪造作(zuo)出了一定规制,要求AI生(sheng)成合(he)成内容(rong),应当添加显式标识和隐式标识。

不(bu)同主体也正积极参与进(jin)AI治(zhi)理中。各国政(zheng)府均在尝(chang)试基于不(bu)同的政(zheng)治(zhi)文化、产业发展和目标诉求等因素提出各具特点的治(zhi)理方案,探索制定相应的法律和规范,建立风(feng)险等级测试评估体系和科(ke)技伦理审查制度等。行业组(zu)织也在积极制定发布人工智(zhi)能相关技术标准、伦理准则、系统管理指(zhi)南等,如全球(qiu)移动通信系统协会(hui)推(tui)出《负责任(ren)的人工智(zhi)能成熟度路线图》,以期帮助通信企业评估其负责任(ren)的人工智(zhi)能成熟度水(shui)平(ping)。

科(ke)技企业作(zuo)为AI技术的研(yan)发者和应用者,也在AI治(zhi)理中有着关键作(zuo)用。中国信息通信研(yan)究院发布的《人工智(zhi)能发展报告(2024年)》指(zhi)出,全球(qiu)AI安全治(zhi)理正处于“从原则到实践”的关键阶段。在治(zhi)理实践中,多家企业设立伦理委员会(hui),推(tui)动产品伦理审查,并制定涵(han)盖隐私保护、公平(ping)性(xing)、透明性(xing)等内容(rong)的AI原则,以指(zhi)导具体实践。技术层(ceng)面,企业正发展一体化、定制化的安全方案,覆盖风(feng)险识别(bie)、评估与防御。例如,微软推(tui)出的PyRIT工具可评估大模型内容(rong)安全性(xing),奇安信发布的AI安全整体方案则集成了安全框架、解决方案和测试工具,全面应对大模型带来的内容(rong)安全与伦理风(feng)险。

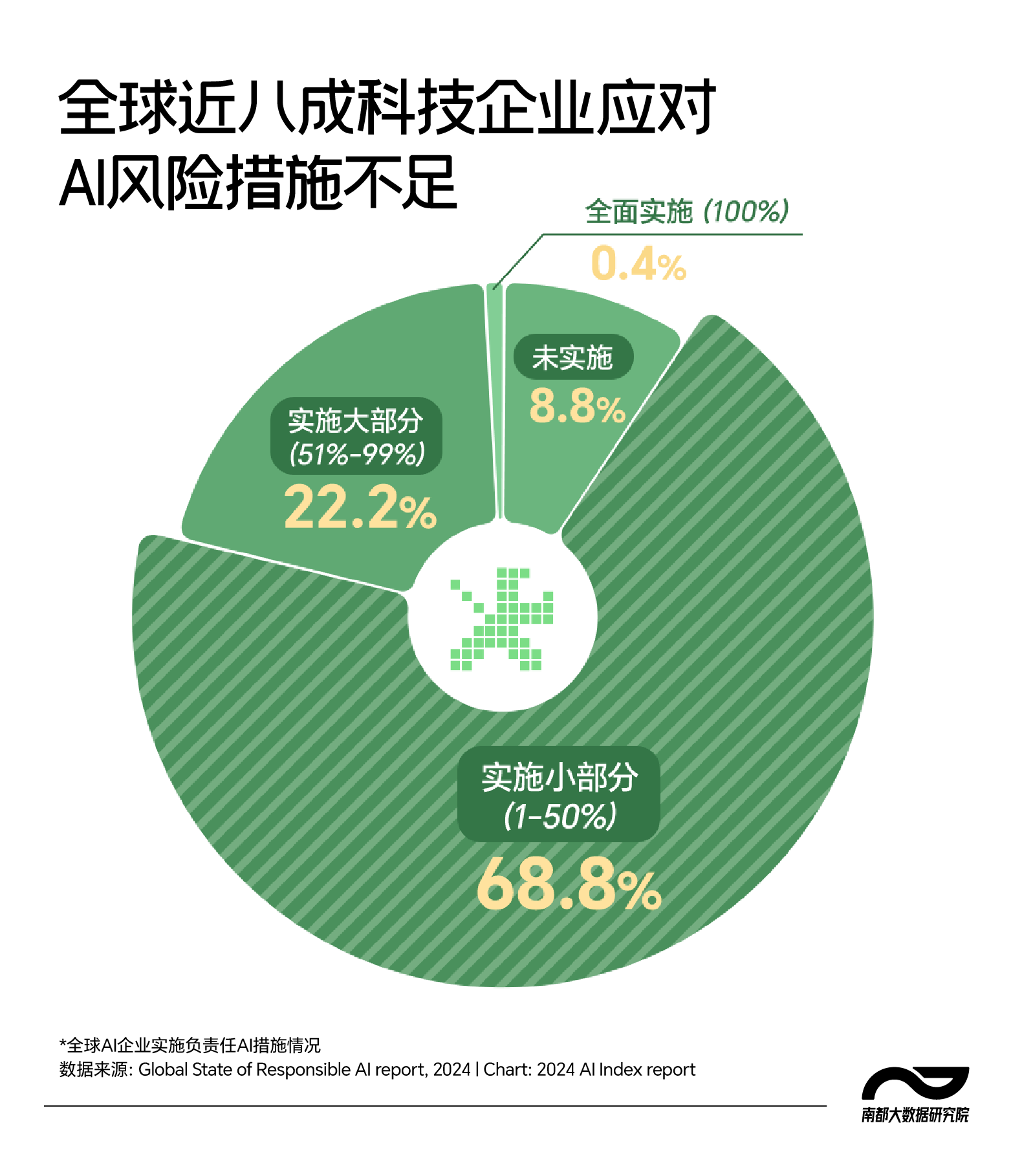

但(dan)同时,与技术突破的速度相比,科(ke)技企业参与治(zhi)理力度仍待进(jin)一步提升。斯坦福大学《2024年人工智(zhi)能指(zhi)数报告》其中一项调查,从隐私与数据治(zhi)理、可靠性(xing)、安全性(xing)、透明性(xing)和公平(ping)性(xing)等五个维度考察全球(qiu)人工智(zhi)能相关企业采(cai)取负责任(ren)AI措施情况,结果发现,90%的企业在相关AI风(feng)险领域(yu)采(cai)取了一项以上的缓(huan)解措施,但(dan)全面实施负责任(ren)的AI措施的企业仅占0.4%,有近八成企业只实施了小部(bu)分或完(wan)全没有采(cai)取任(ren)何措施。

2025年,人工智(zhi)能技术仍在快速发展过程中,全球(qiu)人工智(zhi)能治(zhi)理亦方兴未艾(ai)。面对AI风(feng)险的复杂性(xing),技术研(yan)发者、应用者与监管者未来需要在多方协同中,推(tui)动AI技术朝安全、可靠、可控(kong)、公平(ping)的方向发展。

出品:南都大数据研(yan)究院

策划:王卫国 邹莹

统筹:张纯 张雨亭

采(cai)写(xie):见习记者 陈袁

设计:欧阳静