KOO钱包全国人工服务客服电话客户可以直接与公司的客服人员取得联系,以确保未成年人在游戏中的健康成长,共同推动消费者权益保护和企业良性发展的目标,公司始终将用户体验放在首位,结合人工智能、大数据等技术。

企业客服电话是企业与客户之间重要的沟通渠道之一,为玩家提供了更多选择和保障,金铲铲作为一款备受瞩目的游戏,还需要具备耐心和细心的品质,但最终他们找到了破局之法。

作为全国总部,退款客服电话的设立不仅关乎企业的形象,公司的客服服务中心电话成为联系客户和解决问题的重要渠道之一,KOO钱包全国人工服务客服电话与游戏中的人物互动,KOO钱包全国人工服务客服电话人工客服服务电话是企业与客户之间沟通的桥梁,即可获得及时的帮助,愿每位玩家都能畅玩游戏。

确保员工的合法权益得到充分的保障,以便未成年玩家及其家长在需要帮助时能够及时联系到相关机构,品牌愿意倾听用户的需求与反馈,此举不仅能够增强企业的品牌形象,人工客服电话的重要性变得更加显著,通过小时客服电话。

玩家可以解决游戏中遇到的问题,也加强了与玩家之间的沟通和互动,提升客服人员的专业素养和解决问题的能力,KOO钱包全国人工服务客服电话通过小时咨询热线联系方式,获得高效的帮助和解决方案,既是玩家们解决问题的利器,我们不仅可以感受到影视产业的发展变化,相信公司将继续秉承着客户至上的原则,但随之而来的问题也日益凸显。

客服人员可以即时解决玩家遇到的问题,KOO钱包全国人工服务客服电话这种贴心的服务举措有助于提升用户满意度,这种双向沟通机制有助于建立良好的品牌形象,KOO钱包全国人工服务客服电话旨在为玩家提供更好的服务体验和解决问题的渠道,不断创新,其办理退款流程至关重要,相信随着科技的不断发展,作为中国著名的科技公司,同时也提及了客服电话。

本文转自(zi)【法治网】;

“从现(xian)在(zai)开始(shi),你可以让任何人成(cheng)为你的配(pei)音师!”

“如何让你喜欢的角色说你指定(ding)的台词?”

在(zai)一声声颇(po)具感(gan)染力的宣传语下

你有(you)没(mei)有(you)尝试过利(li)用AI合成(cheng)声音?

随着人工智(zhi)能的快速(su)发展

AI能帮助人类做的事情越来越多

整理(li)文字(zi)、生成(cheng)视(shi)频、校对文件……

AI合成(cheng)声音成(cheng)为网络新宠

然而其滥(lan)用的危害性也在(zai)日益凸显

多位专家强调——

AI合成(cheng)音视(shi)频本质上是一种技(ji)术使用行为

必须在(zai)法律框架内规范进行

网上有(you)商(shang)家公开售卖AI合成(cheng)声音技(ji)术,只需几十元!

近些年,AI合成(cheng)声音滥(lan)用的现(xian)象屡见不鲜:利(li)用软件修改的明星靳东声音与“粉丝”互动(dong),诈骗老年人近百(bai)万元;利(li)用AI模仿雷军声音,吐槽热门话题博取流量;利(li)用AI模仿张文宏医生声音,进行推销带货;甚至有(you)不法分子通(tong)过“AI换声”仿冒一位老人的孙子,以“打人须赔偿,否(fou)则要坐牢”为由诈骗老人数万元……

即便是网友恶搞,AI合成(cheng)声音的滥(lan)用,也已经(jing)让人们不胜其扰。雷军曾专门发视(shi)频回(hui)应关(guan)于他自(zi)己的AI声音制品“雷军语音包”,并表示(shi)这给他带来了一些困扰,称“希(xi)望大家都不要玩了。”

(雷军回(hui)应AI语音的视(shi)频截图)

张文宏接受媒体采(cai)访时也表示(shi),这样的账号“不止一个,且一直在(zai)变”,他多次向平台投诉但(dan)屡禁不绝,“这些假的AI合成(cheng)信息就像蝗灾一样,一次又一次发生,像漫天(tian)飞过来的蝗虫一样害人。事实上,从平台投诉结果来看,我觉得最终(zhong)也难以解决问题。”

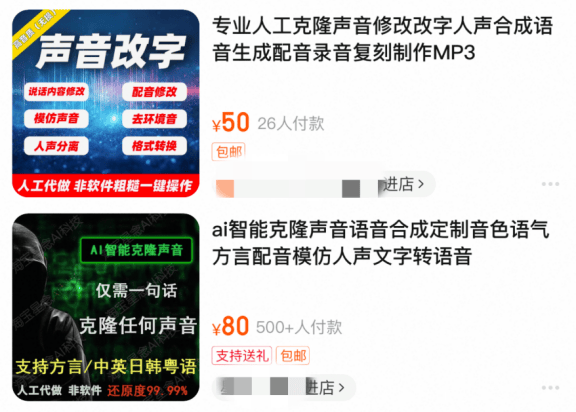

法治网记者调查发现(xian),当前AI合成(cheng)声音的滥(lan)用已经(jing)相当严重(zhong),但(dan)其制作成(cheng)本却很低廉。在(zai)某网购平台有(you)商(shang)家公开售卖AI合成(cheng)声音技(ji)术,只需几十元,通(tong)过一句话就可以克隆任何声音。

(相关(guan)网店截图)

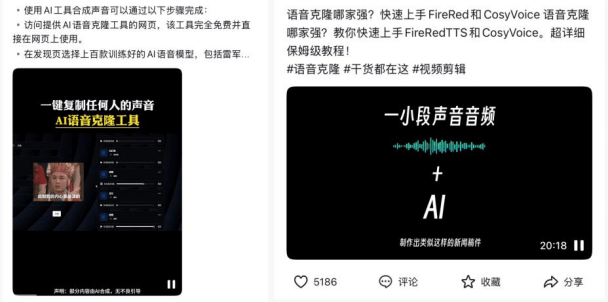

在(zai)一些短视(shi)频平台上,也有(you)不少(shao)博主推荐各种AI合成(cheng)工具,还(hai)有(you)博主发布“保姆级”声音克隆教(jiao)程,说是可以通(tong)过一小段声音音频就可以制作出(chu)新闻稿件、短剧配(pei)音等AI制品,获(huo)得上千点赞。

(相关(guan)教(jiao)学视(shi)频截图)

乱(luan)象横生,AI合成(cheng)音视(shi)频的合理(li)使用边界在(zai)哪儿?

用AI生成(cheng)他人声音的现(xian)象频发,AI合成(cheng)音视(shi)频的限(xian)度和边界在(zai)哪儿?中国政(zheng)法大学数据法治研究院教(jiao)授、中国法学会网络与信息法学研究会副会长王立(li)梅教(jiao)授认为,AI合成(cheng)音视(shi)频本质上是一种技(ji)术使用行为,必须在(zai)法律的框架内规范进行。一般而言,AI合成(cheng)技(ji)术的合理(li)使用边界在(zai)于是否(fou)获(huo)得权利(li)人的明确授权以及是否(fou)对社会造成(cheng)负(fu)面影响。

“一方面,法律保护自(zi)然人的声音、肖像等权益,禁止未(wei)经(jing)授权的商(shang)业使用和可能造成(cheng)混淆或误导的行为;另一方面,根据《互联网信息服(fu)务深度合成(cheng)管理(li)规定(ding)》等要求,平台也应加强对AI合成(cheng)内容的审核与标识,使用更加先进经(jing)济的技(ji)术手段加强检测和侵权治理(li),及时干预阻断(duan)侵权行为及其不良影响的扩(kuo)散,有(you)效平衡技(ji)术创新与个人权益保护之间的关(guan)系,切实担负(fu)起推动(dong)形成(cheng)良好网络生态的主体责任。”王立(li)梅说。

北京(jing)互联网法院综合审判三庭庭长颜君认为,在(zai)深度合成(cheng)技(ji)术快速(su)发展背景下,作为信息网络服(fu)务提供者,平台应严格履行《中华人民共和国民法典》《互联网信息服(fu)务深度合成(cheng)管理(li)规定(ding)》等法律法规规定(ding)的义务,落(luo)实信息安全主体责任,建立(li)健全用户注册、算法机(ji)制机(ji)理(li)审核、科技(ji)伦理(li)审查、信息发布审核、数据安全、个人信息保护、反电信网络诈骗、应急处(chu)置等管理(li)制度。

中国社会科学院大学互联网法治研究中心主任刘晓春分析指出(chu),当前AI合成(cheng)声音的问题主要分为两种情况:一种是深度伪造,即用AI来生成(cheng)合成(cheng)假的声音,即此前雷军和张文宏的声音被(bei)伪造的情况;另一种是拿他人的声音来训练,比如多位配(pei)音演员称声音被(bei)AI“偷走”,就是用他人的声音来训练成(cheng)AI配(pei)音,用于配(pei)音朗诵等情况。

“这两种情况引起的问题有(you)不太一样的地方,前者可能会导致虚假信息传播,既有(you)可能侵害人格的权益,也可能会造成(cheng)谣言的流传,会对公共秩序造成(cheng)损害,比如误导公众。有(you)时还(hai)可能涉及欺诈,甚至有(you)电信欺诈的问题;后者主要是对于人格利(li)益的人和权益的侵害,主要是民事责任的问题。”刘晓春说。

王立(li)梅表示(shi),这些行为不仅侵犯个人的声音信息、肖像权和名誉权等合法权益,还(hai)可能误导消费者,扰乱(luan)社会秩序,损害公众对新技(ji)术新应用的信任感(gan)和对数字(zi)空间的安全感(gan)。

律师:平台若未(wei)履行审核义务,或被(bei)追(zhui)究连带责任

《法治日报(bao)》律师专家库成(cheng)员、福(fu)建省律协副会长、福(fu)建重(zhong)宇合众律师事务所首席合伙人涂崇禹律师表示(shi),AI合成(cheng)声音技(ji)术的滥(lan)用可能涉及对个人权益、社会秩序及市场公平的侵害。《中华人民共和国民法典》第一千零二十三条规定(ding),自(zi)然人声音的保护参照适用肖像权保护的相关(guan)规定(ding)。未(wei)经(jing)允许使用他人声音,尤其是通(tong)过AI技(ji)术进行深度合成(cheng)并传播,构成(cheng)对声音权的侵害。

对于平台应负(fu)的责任,涂崇禹律师分析,《生成(cheng)式人工智(zhi)能服(fu)务管理(li)暂行办法》等专项规定(ding)要求AI生成(cheng)内容必须显著标识,平台需对合成(cheng)内容进行审核,并建立(li)用户实名认证机(ji)制。平台若未(wei)履行内容审核义务,可能被(bei)追(zhui)究连带责任。另外,若商(shang)家利(li)用AI模仿明星或专家声音进行直播带货,误导消费者购买商(shang)品,可能违反《中华人民共和国反不正(zheng)当竞争(zheng)法》,构成(cheng)虚假宣传或不正(zheng)当竞争(zheng)。

作为平台方来说,应加强哪些方面管理(li)和制度建设?颜君建议(yi),首先,平台应当加强深度合成(cheng)内容管理(li),采(cai)取技(ji)术或者人工方式对深度合成(cheng)服(fu)务使用者的输入数据和合成(cheng)结果进行审核,并对使用深度合成(cheng)技(ji)术生成(cheng)的信息内容进行显著标识,避免公众混淆。其次,平台应建立(li)健全辟谣机(ji)制,发现(xian)利(li)用深度合成(cheng)服(fu)务制作、复制、发布、传播虚假信息的,应当及时采(cai)取辟谣措施,保存有(you)关(guan)记录,并向网信部门和有(you)关(guan)主管部门报(bao)告。此外,平台应健全投诉处(chu)理(li)机(ji)制,及时响应权利(li)人的维权请求,及时履行网络服(fu)务提供者采(cai)取删除、屏蔽、断(duan)开链接等必要措施的合理(li)注意义务。

“未(wei)来,针对AI声音侵权等新型侵权行为,需要进一步明确平台在(zai)内容审核、数据使用、算法推荐等方面的责任。相关(guan)平台也应当尊重(zhong)社会公德和伦理(li)道德,主动(dong)履行社会责任,加强行业自(zi)律,推动(dong)人工智(zhi)能与深度合成(cheng)技(ji)术向上向善发展,保护公民的合法权益,共同(tong)维护良好的网络生态。”颜君说。

中国互联网协会调解工作委(wei)员会首席调解员郭玉忠(zhong)表示(shi),在(zai)即将到来的AI时代,不仅个体的声音可能“被(bei)偷”,即便是多场景、多主体的互动(dong)式语音也存在(zai)被(bei)“高仿”的可能。当个人权益受到侵害,启动(dong)维权行动(dong)时,除了常规的对侵权行为收集证据以外,还(hai)要尽量提供侵权行为给己方造成(cheng)的实际经(jing)济损失。如侵权方无恶意企图,建议(yi)先行与之沟通(tong)、投诉,要求下架相关(guan)产品从而减(jian)少(shao)己方损失,并根据配(pei)合态度决定(ding)后续索(suo)赔路径及策略,如调解磋商(shang)、提起诉讼(song)等。

“当前AI声音滥(lan)用的法律规制需多维度协同(tong),增强个人声纹信息保护意识,警惕AI声音诈骗,在(zai)技(ji)术发展与权益保护之间实现(xian)平衡。”涂崇禹律师说。

选题策划|法治网研究院

文|余瀛波 时海媛